【2023年11月08日訊】(記者殷瑞娜編譯報導)當YouTube網紅加比·貝爾(Gabi Belle),得知有一張自己的裸照在網絡上流傳時,她的身體變得冰冷。她從未拍過這張照片,這張照片顯示,她赤身裸體地站在田野裡。她知道這一定是假的。

26歲的貝爾給一位同事發訊息,請求幫助刪除該圖片。同事告訴她,網絡上散布著她的近100張偽造照片,大部分都存放在以存放人工智能生成的色情內容而聞名的網站上。

貝爾說,這些照片已於7月被撤下,但描繪她性愛場景中的新照片已經浮出水面。

「我感到噁心和被侵犯」,貝爾在接受採訪時說,「那些私密部位不應該讓全世界看到,因為我沒有同意,所以有人偽造了我的照片,真的很奇怪。」

今年,人工智能正在推動虛假色情圖片和視頻的空前繁榮。

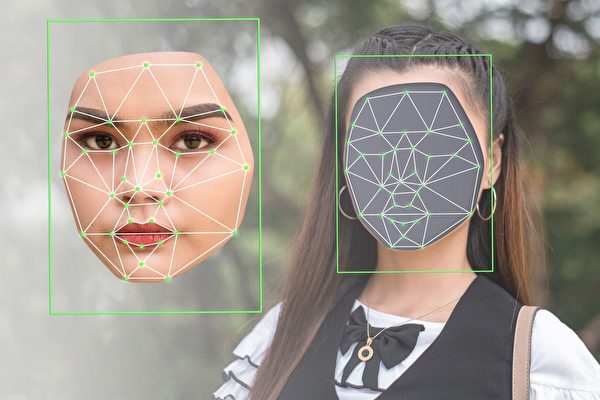

這得益於廉價且易於使用的人工智能工具的興起,這些工具可以「脫掉」照片中的人的衣服,分析他們赤裸的身體會是什麼樣子,並呈現在圖像中,或者將人臉無縫地替換到色情視頻中。

據行業分析師吉納維夫·歐(Genevieve Oh)稱,自2018年以來,在存放人工智能生成的色情照片的前10個網站上,偽造裸照數量激增了290%以上。

這些網站以名人和政治人物為目標,他們的肖像被不良行為者利用,來羞辱目標人物、勒索金錢或滿足私人幻想。

受害者求助無門。目前還沒有聯邦法律來規範深度偽造的色情內容,只有少數幾個州頒布了相關法規。

拜登總統上週一(10月30日),發布的人工智能行政命令建議,但沒有要求公司,對人工智能生成的照片、視頻和音頻進行標記,以表明是電腦生成的作品。

同時,法律學者警告說,人工智能偽造的圖像,可能不受個人肖像的版權保護,因為它們取自包含數百萬張圖像的資料集。

舊金山大學法學教授蒂芙尼·李(Tiffany Li)表示:「這顯然是一個非常嚴重的問題。」

人工智能圖片的出現,為女性和青少年帶來了特別的風險,他們中的許多人還沒有為這種情況做好準備。

監控深度偽造(Deepfake)的公司Sensity AI,在2019年的研究發現,96%的深度偽造圖片都是色情內容,其中99%的照片是女性。

「現在它主要針對女孩,」賓州大學研究員兼數位權利倡導者索菲·馬多克斯(Sophie Maddocks)說,「那些不在公眾視野中的年輕女孩和婦女。」

一名14歲的女孩也在網絡上發現了一張自己的裸照。

她從來沒有拍過裸照。據警方稱,一群當地男孩從他們鎮上幾名女孩的社交媒體資料中,抓取了穿著衣服的照片,然後使用人工智能「裸體器」應用程序,創建了這些裸體照片。

歐檢查了排名前10名的偽造色情圖片網站時,她發現,今年上傳的偽造色情圖片超過415,000張,瀏覽量接近9,000萬次。

人工智能生成的色情視頻也在網絡上爆發。

在搜尋了40個最受歡迎的偽造視頻網站後,歐發現,2023年新增視頻超過143,000個,這一數字超過了2016年至2022年所有新視頻。歐發現,偽造視頻的觀看次數超過42億次。

美國聯邦調查局(Federal Bureau of Investigation),6月警告稱,詐騙者的性勒索行為有所增加,要求支付費用或照片,以換取不傳播色情圖片。雖然尚不清楚這些圖像中有多少是由人工智能生成的,但這種做法正在擴大。

FBI告訴《華盛頓郵報》,截至9月,已有超過26,800人成為「性勒索」活動的受害者,比2019年增加了149%。

谷歌制訂了相關政策,來防止未經同意的色情圖片出現在搜尋結果中,但對深度偽造圖片的保護措施,並不那麼強大。

即使沒有特別搜尋人工智能生成的內容,深度偽造色情圖片以及製作工具,也會出現在該公司搜尋引擎的顯著位置。

歐在螢幕截圖中記錄了十多個範例,這些範例均得到了《華盛頓郵報》的獨立證實。

在沒有聯邦法律的情況下,至少有九個州,包括加州、德州和維吉尼亞州,已經通過了針對深度偽造的法案。但這些法律的範圍各不相同。

在某些州,受害者可以提出刑事指控,而有些州則只允許提起民事訴訟,儘管很難確定該起訴誰。

科技人權倡導組織「見證者」(Witness)執行董事,山姆·格雷戈里(Sam Gregory)表示,推動對人工智能生成的圖像和視頻進行監管,通常是為了防止大規模傳播,從而解決對選舉干擾的擔憂。

但格雷戈里補充說,這些規則對深度偽造色情內容,沒有什麼作用,因為在小範圍內共享的圖片,可能會對一個人的生活造成嚴重破壞。◇